RDU

AIのために設計された再構成可能なデータフローユニット (RDU)

高速かつ省エネルギーなAI推論を実現

第4世代RDU「SN40」は、卓越したパフォーマンスを提供するよう設計されています。最も負荷の高いAIワークロードにも対応できる唯一無二の能力を持ち、圧倒的な効率性でそのすべてを実現します。

Headline here

From chips to racks

The combination of 16 SN40L RDUs creates a single, high-performance rack that can run the largest models, such as DeepSeek R1 671B and Llama 4 Maverick, with the fast inference. These racks can be seamlessly integrated into any existing air-cooled data center.

Learn more →

シームレスにハイパフォーマンスを実現

半導体からラックまで一貫設計

16基のSN40 RDUを組み合わせることで、DeepSeek R1 671BやLlama 4 Maverickといった最大規模のモデルも高速推論できる、高性能な1台のラックが完成します。これらのラックは、既存の空冷式データセンターにもシームレスに統合可能です。

詳細はこちら →

データフローアーキテクチャ

革新的なコンピュートおよびメモリのチップレイアウトにより、AIモデルの処理時に演算間でのデータフローをシームレスに実現します。このアーキテクチャにより、高速なデータ転送と、パフォーマンスおよび効率性の大幅な向上が可能になります。

詳細はこちら →

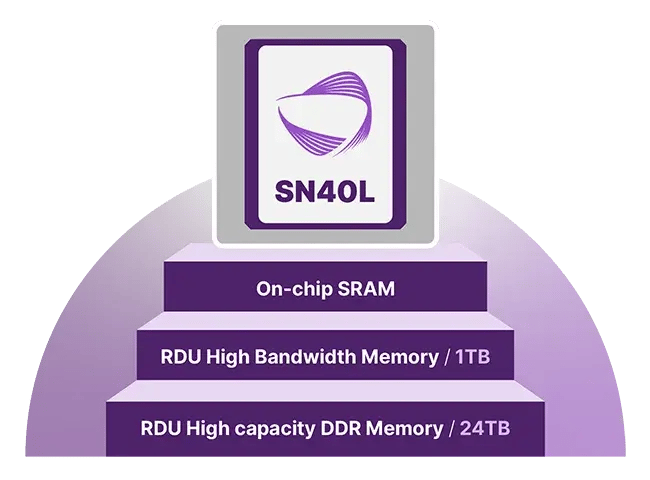

効率性を追求した3階層メモリ構成

SN40Lは、複数のモデルをメモリ上で同時に保持し、マイクロ秒単位でのモデル切り替えを可能にする設計です。この独自のメモリ構成により、SambaNovaはDeepSeekやLlama 4といった超大規模モデルにも単一ラックで対応できるスケーラビリティを実現しています。

詳細はこちら →インフラを将来にわたって対応可能なものに

第4世代RDU「SN40」は、SambaNovaソリューションプラットフォームの中核です。

関連リソース